一直做智能客服这么久, 也测试过很多其他家的智能客服。 比如阿里小蜜,小i机器人,微软小冰等等。 不过那都是抱着试试看的角度, 有时候也想不起以前自己的实际使用场景, 并没有尝试真正需要解决问题。 这次正巧, 在招行上面找在线客服的时候, 就无意中体验了一把智能客服, 而且感觉效果还不错。 几个觉得做得不错的地方: 首先我也担心是不是有客服在线, 就问了是否有人, 秒回一个“嗯嗯, 在呢”。 感觉像真人一样, 其次, 当我正在输入问题的时候, 因为输入有一些时间, 他等了一会就自动蹦出一个: 您好,请详细说明您的问…

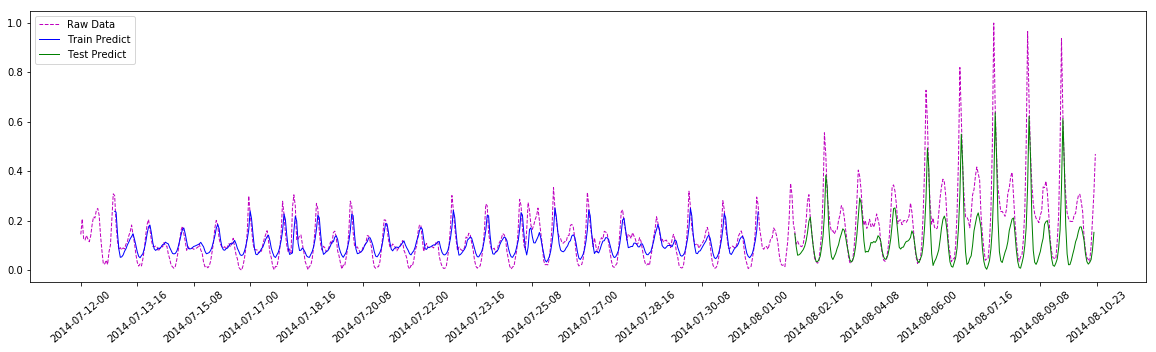

本次命题: 数值预测 上一篇文章我们的小题目是使用LSTM预测字符顺序的下一个字符。 命题虽然简单, 可是实际上应用范围也很广。 比如输入法里面, 就一定会用到相关的技术。 只不过不一定是LSTM, 肯定也不止一维特征。这次这个命题相对来说, 比较实际一些:从历史预测监控数据预测即将来临的监控指标的数值。 比如下图就是本站在友盟上面的监控数据。 最右边的虚线部分就是友盟进行的预测的数值: 本文代码特别鸣谢:https://blog.csdn.net/aliceyangxi1987/article/details/7…

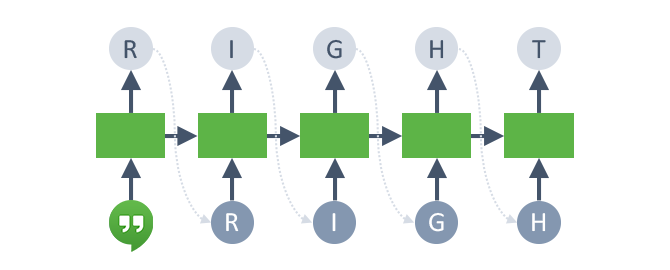

LSTM 应该是这段时间应用非常广泛也非常火的一个算法了。关于其理论基础, 已经有非常好的文章了。 在这里, 笔者记录一下自己从一些实际例子来学习LSTM的路程。 不太监的话, 应该会有好几篇文章。 这是第一篇, 主要目的: 从一个简单的例子来看看LSTM是如何预测下一个输出的。 从这个简单的例子, 体会一下什么是Seg2Seg。 大概看看, 如何使用Keras来训练一个LSTM的模型。 主要参考文章: 在keras 上实践,通过keras例子来理解lstm循环神经网络 Understanding Stateful…

想解决的问题 一个通用的模型, 希望能适用所有的日志. 比如常见的System Event Log. 尝试从这些大量的日志之中找到异常\不规则的地方 主要架构 分为3个模型: Log Key Anomaly Detection model 主要是根据生成的Log Key, 使用LSTM进行判断下一个Log Key是否是异常信息. 主要是使用了NLP的思想. 个人感觉这一块是DeepLog最有启发的一个模型. Workflows 主要是能识别出并行的日志. 但是具体怎么用, 没有(在Youtube视频上面)详细说明 …

论文标题: From Word Embeddings to Item Recommendation 论文地址: https://arxiv.org/pdf/1601.01356 核心思想 这一篇论文的思想相比起其他的论文来说, 思想非常简单,就是把Item 当成一句话之中的Word。 使用训练Word2Vec模型的方法来训练一个Item2Vec 这种方法我还是比较认同的, 因为需要的数据比较简单, 是实际生产之中的应用场景会多不少. 训练数据 论文之中提到的数据集太老了(2011年), 没找到. 因为论文之中提到的…

目前很火的芝士超人、百万英雄等等,已经有不少人做了答题辅助。 比如: https://github.com/Skyexu/TopSup https://github.com/rrdssfgcs/wenda-helper 但是个人感觉,他们都缺少了最后一公里: 需要人手工触发。 我们目前做的这个事情,就是尝试把最后一公里简化, 你只需要 调用我们的API 或者基于我们的源码与模型, 在本地搭建一个你自己的API, 之后只需要不停的执行截图并调用API获取结果就可以了。 项目地址:https://github.com/…

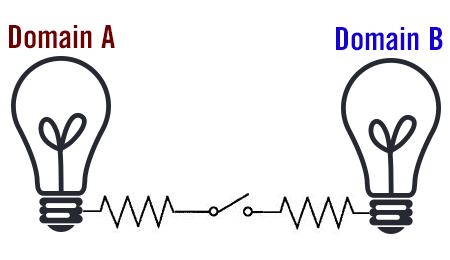

论文链接: http://aclweb.org/anthology/D17-1312 这一篇论文, 主要想解决的问题是在一个新的领域, 当现有的语料不足够大的时候, 如何充分利用之前已经有的一些语料增强当前领域的词向量模型。 具体算法并不复杂, 不过感觉距离实用还是有一些距离: 首先需要原始语料,而不是原始语料训练出来的模型 因为需要得到一个词在原始语料的概率分布 还需要一个词同时在两个语料之中同时出现。 可是目前的情况是, 我们只有Google / Facebook / Stanford 等发布的大规模训练出来的…

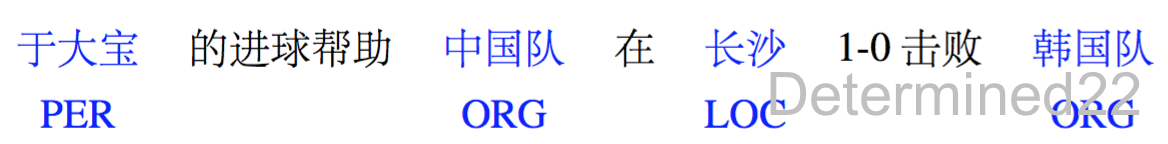

引言: 因为在工作之中接触到NER,并且可以有需要NER的地方。在此总结一些相关资料与自己的理解。 什么是命名实体识别 此段原文: http://blog.csdn.net/dvstream/article/details/17784293 命名实体识别(Named Entity Recognition, NER),又称作“专名识别”,主要任务是识别出文本中的人名、地名等专有名称和有意义的时间、日期等数量短语并加以归类。对很多文本挖掘任务来说,命名实体识别系统是重要的组成部分:一方面,命名实体识别可以帮助识别未登录…

荷兰航空 KLM Royal Dutch Airlines - 提醒客户飞机状态 点评: 感觉这个Bot还挺实用的。 Facebook针对航班还有特殊的消息模板。 看了一下, 自定义的地方也挺强的。 如果国内能访问的话, 其实可以改造成高铁的提醒。 Whole Foods Market - 智能食谱 Messenger链接: https://www.messenger.com/t/24922591487 开场白: 简单测试了一下: I love to eat some cake 点评: 感觉还是关键词匹配。我本身对…

之前在看Keras Example的时候, 发现对于NLP相关的任务使用的NN都非常浅。 没有很严谨的去数, 但是基本上都是一两层网路就结束了。 具体可以参考Keras Example 之中IMDB相关的代码。 当然, 效果也不差。 一直对这一块很奇怪。 偶然从知乎上面的一篇文章获得解答。 参考: 如何评价Word2Vec作者提出的fastText算法?深度学习是否在文本分类等简单任务上没有优势? 简要观点: 项亮: 文本分类基本还是个偏线性的问题。多层的网络相对单层的没有太多优势。但这不是说多层的没用,而是单层的…